Secondo uno studio di IBM, la responsabilità dell’etica dell’intelligenza artificiale non sarà più appannaggio esclusivamente dei team IT aziendali. Promossa da IBM Institute for Business Value (IBV), la ricerca “L’etica dell’AI in azione: una guida aziendale per il progresso affidabile dell’AI” ha coinvolto 1.200 manager appartenenti a 22 settori in 22 Paesi. Focus su dove i manager si posizionano riguardo all’importanza dell’etica dell’AI e come le organizzazioni la stanno rendendo operativa. Lo studio è stato condotto in collaborazione con Oxford Economics nel 2021.

I dirigenti forza trainante

La ricerca IBM ha rivelato il sentiment del management rispetto al tema dell’etica dell’AI.

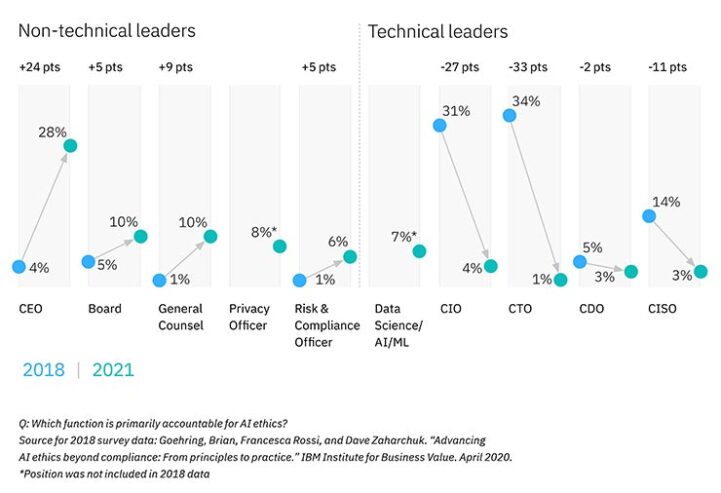

I Ceo (28%), i membri del cda (10%), il team legale (10%), i responsabili della privacy (8%) e del Risk & Compliance (6%) sono considerati come i più responsabili relativamente all’etica AI. Il 66% degli intervistati cita il Ceo o altri membri della Direzione Generale come coloro che hanno influenza sulla strategia etica della loro organizzazione. Più della metà cita le direttive del consiglio (58%) e la comunità degli azionisti (53%). Costruire un’AI degna di fiducia è percepito come un valore strategico differenziante e le organizzazioni stanno iniziando a mettere in atto attività relative all’etica dell’AI. Più di tre quarti dei leader aziendali intervistati quest’anno concordano sul fatto che l’etica dell’AI è importante per le loro organizzazioni. In aumento rispetto al 50% circa del 2018.

I team IT e l’etica dell’intelligenza artificiale

Il 75% degli intervistati ritiene che l’etica sia un valore differenziate di competitività. Oltre il 67% degli intervistati che vedono l’AI e l’etica dell’AI come importanti indicano come le organizzazioni superino le aziende loro pari in sostenibilità, responsabilità sociale e diversità e inclusione. Molte aziende hanno iniziato a fare passi avanti. Infatti, più della metà degli intervistati afferma che le loro organizzazioni stanno lavorando per incorporare l’etica dell’AI nel loro attuale approccio all’etica aziendale. Più del 45% afferma che le loro organizzazioni hanno creato attività specifiche per l’etica dell’AI. Ad esempio: un quadro di valutazione del rischio dei progetti di AI e un processo di revisione e controllo.

Cresce l’attenzione al tema

Assicurare che i principi etici siano inlcusi nelle soluzioni di AI è un’urgente necessità, ma il progresso è ancora troppo lento. Più a.d. tra gli intervistati (79%) sono ora pronti a incorporare l’etica dell’AI nelle loro attività relative all’AI (in aumento rispetto al 20% del 2018). Più della metà delle organizzazioni che hanno risposto hanno pubblicamente approvato principi comuni relativi all’etica dell’AI. Eppure, meno di un quarto delle organizzazioni intervistate ha già reso operativa l’etica dell’AI.

I team IT e l’etica dell’intelligenza artificiale. Una ricerca IBM

Inoltre meno del 20% degli intervistati concorda sul fatto che pratiche e azioni aziendali corrispondano (o superino) i loro principi e valori dichiarati. Il 68% delle organizzazioni intervistate riconosce che comprendere nei team di sviluppo persone dalle diverse caratteristiche sia importante per mitigare i bias nell’AI. Tuttavia i risultati indicano che i team AI sono ancora sostanzialmente meno diversificati nelle loro aziende. Infatti sono 5,5 volte meno inclusivi delle donne, 4 volte meno inclusivi degli individui LGBT+ e 1,7 volte meno inclusivi dal punto di vista razziale.

Un’AI affidabile imperativo di business

Jesus Mantas, Global Managing Partner, IBM Consulting

Dal momento che molte aziende oggi utilizzano algoritmi di AI per gestire il loro business, affrontano potenzialmente numerose richieste interne ed esterne affinché questi algoritmi vengano progettati in modo etico, sicuro e che ispiri fiducia. Al momento però ci sono stati pochi progressi per incorporare l’etica dell’AI nelle loro attività. I risultati dello studio IBV dimostrano che la creazione di un’AI affidabile è un imperativo di business e un’aspettativa da parte della società, non solo un problema di conformità. Le aziende quindi possono implementare un modello di governance e incorporare principi etici attraverso l’intero ciclo di vita dell’AI.

Il momento per agire è ora

I dati dello studio suggeriscono che le organizzazioni che implementano un’ampia strategia basata sull’etica dell’AI e connessa a tutte le unità di business potranno avere un vantaggio competitivo. Lo studio fornisce alcune indicazioni per i leader aziendali

- Adottare un approccio cross funzionale e collaborativo. L’etica dell’AI richiede un approccio olistico e un insieme di competenze che riguardano tutti gli stakeholder coinvolti nel processo di sviluppo. I membri della direzione generale, i designer, gli scienziati e gli ingegneri dell’AI hanno ciascuno un ruolo distinto da svolgere nel percorso verso l’AI affidabile.

- Stabilire una governance sia organizzativa che del ciclo di vita dell’AI per rendere operativa la disciplina dell’etica dell’AI. Occorre adottare un approccio olistico per incentivare e gestire le soluzioni di AI durante l’intero ciclo di vita, dalla creazione della giusta cultura per un’AI responsabile, alle pratiche e alle politiche fino ai prodotti.

- Andare oltre la propria organizzazione creando partnership. Espandete il vostro approccio identificando e coinvolgendo partner tecnologici focalizzati sull’AI, accademici, startup e altri partner dell’ecosistema. Una soluzione per stabilire una “interoperabilità etica” (ethical interoperability).