Le GPU AMD Instinct MI350 PCIe offrono prestazioni AI di alto livello e sono progettate per adattarsi all’infrastruttura dei data center aziendali.

Man mano che le organizzazioni adottano l’IA, molte scoprono che la loro infrastruttura fatica a stare al passo. Eseguire l’IA nel cloud è un’opzione, ma il cloud può introdurre problemi di privacy e costi imprevedibili. Aggiornare l’infrastruttura on-premise è un’altra opzione, ma supportare grandi piattaforme di acceleratori GPU può richiedere costose riprogettazioni a livello energetico e di raffreddamento dei data center.

Agentic AI direttamente in-house: in vantaggio per le imprese

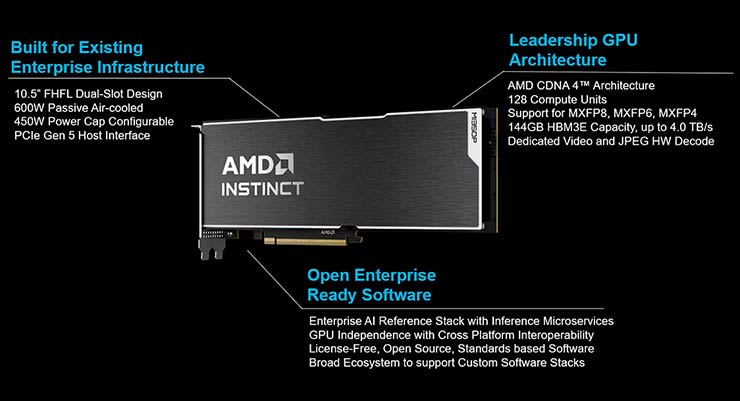

Progettate per agevolare l’ingresso dell’IA agentica, gli acceleratori AMD Instinct MI350P PCIe sono schede drop-in a doppio slot per server raffreddati ad aria standard. Le GPU AMD Instinct su schede PCIe economiche completano il portafoglio di calcolo AI AMD, offrendo una gamma di opzioni per le imprese che stanno affrontando l’adozione dell’IA.

Disponibili in sistemi raffreddati ad aria con fino a otto schede acceleratore, le schede AMD Instinct MI350P PCIe sono ideali per modelli AI di piccole, medie e grandi dimensioni, per pipeline di inferenza e RAG.

Le caratteristiche chiave aiutano ad aumentare le prestazioni, semplificare il deployment e ridurre i costi, così da poter passare dalla valutazione ai risultati reali:

- Supporto nativo per MXFP6 e MXFP4 a bassa precisione, che garantiscono alta produttività.

- Accelerazione tramite supporto di scarsità per la maggior parte delle precisioni mainstream a 8 e 16 bit.

- Stimate 2.299 teraflops (TFLOPS) e fino a 4.600 TFLOPS di picco a MXFP4, le prestazioni più alte attualmente disponibili in una scheda PCIe aziendale.

- Stimato 144GB di memoria ad alta larghezza di banda 3e (HBM3E) che funziona fino a 4TB/s.

- L’ecosistema aperto con opzioni di stack di sviluppo a basso o senza costo semplifica il deployment e aiuta a ridurre le spese operative.

Software aziendale – sviluppare lo stack AI

Le GPU AMD sono realizzate a partire da standard aperti, per assicurare l’interoperabilità multipiattaforma. In questo modo possono diventare il componente fondamentale dello stack di intelligenza AI aziendale.

La piattaforma include Kubernetes GPU Operator, per la gestione completa del ciclo di vita, i microservizi AMD Inference nativi cloud e il supporto per framework AI come PyTorch. Tutto questo ti permette di migrare carichi di lavoro di inferenza con modifiche minime al codice.

AMD fornisce questo stack di riferimento per l’enterprise AI open source senza costi di licenza per i partner. Ciò assicura maggiore trasparenza del codice e aiuta a ridurre le spese operative.

Accelerazione nativa su più livelli

Le schede AMD Instinct MI350P PCIe supportano lo spettro di livelli di precisione su cui i modelli di intelligenza artificiale aziendali si basano maggiormente.

Mentre MXFP6 e MXFP4 a bassa precisione offrono prestazioni massimizzate in TFLOPS puro e implementazioni efficienti di modelli, formati ad alta precisione come INT8 e BF16, beneficiano del supporto GPU AMD Instinct MI350P per garantire prestazioni efficienti.

Il supporto per FP8, MXFP8 e MXFP4 è una delle ragioni principali per cui le schede AMD Instinct MI350P PCIe possono elaborare i carichi di lavoro AI odierni all’interno di data center standard raffreddati ad aria.

Con le schede AMD Instinct MI350P PCIe, le aziende possono passare rapidamente dall’infrastruttura bare-metal a sistemi AI pronti per la produzione su solide fondamenta. Permettono di migrare i carichi di lavoro senza riscrivere codice, di integrarli con pipeline di AI esistenti e di scalare con carichi di lavoro in evoluzione.