Il chip maker annuncia l’acceleratore AMD Instinct MI100 per HPC ad alte prestazioni, la prima GPU x86 a superare i 10 TFlops FP64.

Supportato dalle nuove piattaforme Dell, Gigabyte, HPE e Supermicro, MI100 combina le CPU EPYC e la piattaforma software open ROCm 4.0.

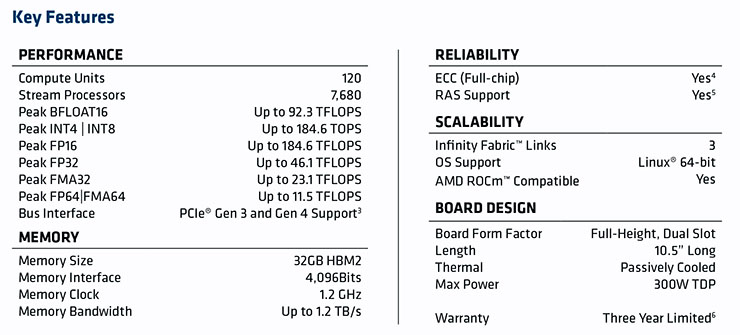

L’architettura offre fino a 11,5 TFlops di prestazioni FP64 di picco per HPC e prestazioni di picco FP32 fino a 46,1 TFlops, per carichi di lavoro AI e machine learning. La tecnologia AMD Matrix Core consente a MI100 di accelerare fino a 7 volte le prestazioni teoriche in virgola mobile di picco FP16.

Il software per sviluppatori AMD ROCm fornisce le basi per l’elaborazione exascale. Essendo un set di strumenti open source costituito da compilatori, API di programmazione e librerie, ROCm è utilizzato dagli sviluppatori di software per creare applicazioni ad alte prestazioni.

AMD Instinct MI100

ROCm 4.0 è stato ottimizzato per fornire prestazioni su larga scala per i sistemi basati su MI100. Si tratta di un compilatore aggiornato, capace di supportare ambienti open source e OpenMP 5.0 che HIP. I framework PyTorch e Tensorflow, che sono stati ottimizzati con ROCm 4.0, possono ora ottenere prestazioni più elevate con MI100.

Funzionalità e caratteristiche chiave dell’acceleratore:

- Nuova architettura AMD CDNA: progettata per alimentare le GPU AMD per l’era exascale e nucleo dell’acceleratore MI100.

- Prestazioni FP64 e FP32 leader per carichi di lavoro HPC

- Nuova tecnologia Matrix Core per HPC e AI

- Tecnologia AMD Infinity Fabric di seconda generazione: fornisce il doppio della larghezza di banda di picco peer-to-peer (P2P) su PCIe 4.0 con un massimo di 340 GB/. In un server, le GPU MI100 possono essere configurate con un massimo di due hive quad GPU completamente connesse, ciascuna che fornisce fino a 552 GB/s di larghezza di banda per una rapida condivisione dei dati.

- Memoria HBM2 ultraveloce – 32 GByte con una frequenza di clock di 1,2 GHz e bandwidth di 1,23 TB/s.

- Supporto per il bus PCIe Gen 4.0, che fornisce fino a 64 GB/s di larghezza di banda teorica massima dalla CPU alla GPU.